IA, marketing et données clients : ces erreurs RGPD peuvent coûter 20 millions d’euros aux PME

Sommaire

- Pourquoi l'IA marketing expose-t-elle particulièrement les TPE et PME aux risques RGPD ?

- Faut-il un DPO quand on fait du scoring ou de la personnalisation à grande échelle ?

- Les trois erreurs qui coûtent cher en marketing IA

- Comment appliquer concrètement le RGPD à vos projets IA marketing ?

- AI Act 2026 : ce que les outils marketing doivent anticiper dès maintenant

- Bonnes pratiques pour un data scientist marketing en PME

- FAQ IA marketing

L'intelligence artificielle s'est glissée partout dans les outils marketing des TPE, PME et freelances. Segmentation prédictive, scoring de leads, recommandations produits, chatbots, contenus personnalisés à la volée… Ces technologies promettent des gains de performance réels. Et elles les tiennent souvent.

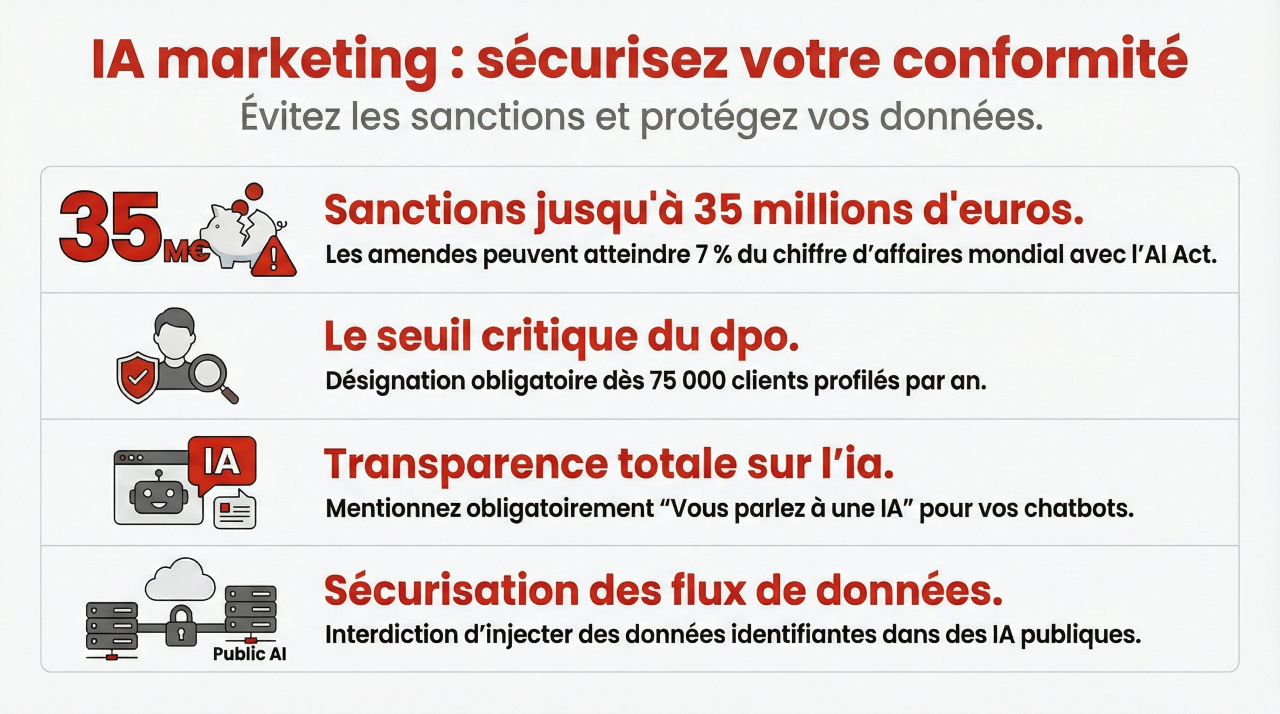

Mais derrière cette promesse se cache un enjeu que beaucoup d'entrepreneurs français sous-estiment encore : la conformité au RGPD et, depuis février 2026, à l'AI Act européen. Les amendes peuvent atteindre 20 millions d'euros ou 4 % du chiffre d'affaires mondial côté RGPD. Et jusqu'à 35 millions d'euros ou 7 % du chiffre d'affaires pour les pratiques interdites par l'AI Act.

Alors, quelles sont les bonnes pratiques à adopter dès aujourd’hui ?

Maîtrisez les risques liés à l'usage de l'IA avec Hiscox

Hiscox propose une assurance dédiée aux professionnels du marketing et de la communication

Pourquoi l'IA marketing expose-t-elle particulièrement les TPE et PME aux risques RGPD ?

Les métiers du marketing et de la communication manipulent chaque jour une grande diversité de données :

- Données CRM : identité, historique d'achats, réponses aux campagnes.

- Données comportementales : navigation web, paniers abandonnés, clics.

- Données relationnelles : tickets support, conversations chatbot, avis clients.

Ces traitements reposent souvent sur du profilage, c'est-à-dire l'analyse automatisée de données personnelles pour évaluer des comportements ou des préférences. Or le RGPD encadre cela très strictement : base légale, information des personnes, droits d'accès et d'opposition, sécurité des données.

Un scoring de churn ou de propension à l'achat mal documenté peut entraîner une amende allant jusqu'à 20 millions d'euros, la suspension de vos campagnes et une perte de confiance client parfois difficile à récupérer.

Obtenez un résumé de l'article :

Faut-il un DPO quand on fait du scoring ou de la personnalisation à grande échelle ?

La question revient souvent et mérite une réponse claire. Le DPO (délégué à la protection des données) est obligatoire dans trois situations prévues par l'article 37 du RGPD :

- Les organismes publics.

- Le suivi régulier et systématique à grande échelle (profilage marketing intensif, tracking web massif).

- Le traitement à grande échelle de données sensibles (santé, biométrie, opinions, etc.).

En contexte marketing et CRM avec IA, c'est le deuxième cas qui s'applique le plus souvent. Si vous profilez plus de 75 000 clients par an (référence CNIL/EDPB), la désignation d'un DPO devient obligatoire. Ne pas le faire expose à une amende pouvant atteindre 10 millions d'euros ou 2 % du chiffre d'affaires mondial.

Deux options s'offrent à vous :

Critère | DPO interne | DPO externe |

Taille entreprise | > 250 salariés | PME / ETI |

Budget | 60 000 à 90 000 € / an | 5 000 à 20 000 € / an |

Complexité IA | Très élevée | Outils SaaS standards |

Indépendance | À garantir en interne | Plus simple à assurer |

Pour une TPE ou un freelance utilisant des outils IA marketing, un DPO externe mutualisé est souvent la solution la plus accessible et la plus efficace.

Les trois erreurs qui coûtent cher en marketing IA

Les situations de non-conformité recensées en France gravitent autour des mêmes manquements. Les voici, pour ne pas les reproduire.

1. Absence de consentement clair

Utiliser un outil IA pour segmenter des données CRM et de web tracking sans consentement spécifique, ni information sur l'usage algorithmique, expose à une violation des articles 5, 6 et 13/14 du RGPD.

Résultat observé dans des cas réels : suspension des campagnes, amende de plusieurs millions d'euros et reconstruction complète de la base de consentements.

2. Faille de sécurité

Déployer un chatbot IA alimenté par des historiques clients sans chiffrement adéquat ni AIPD (Analyse d’Impact relative à la Protection des Données) préalable, c'est s'exposer à une sanction pour violation des articles 32 (sécurité) et 35 (analyse d'impact).

Dans un cas du secteur santé : amende proche de 4 % du chiffre d'affaires, obligation de notifier 100 000 personnes et action collective.

3. Réutilisation des données sans test de compatibilité

Intégrer un modèle prédictif de churn basé sur des emails et appels clients sans documenter la nouvelle finalité IA peut entraîner une amende pour absence de registre des traitements, un intérêt légitime mal pondéré et un coût de mise en conformité supérieur au chiffre d'affaires attendu du projet.

Comment appliquer concrètement le RGPD à vos projets IA marketing ?

Voici comment transformer les principes en actions du quotidien.

Clarifier les usages et la base légale

Avant tout projet IA, commencez par définir précisément la finalité (par exemple : recommandations d'achats), vérifier la base légale (intérêt légitime ou consentement explicite) et réaliser un test de compatibilité si vous réutilisez des données existantes.

Respecter les principes fondamentaux

- Minimisation : pas de collecte "au cas où".

- Limitation de conservation : purge ou anonymisation automatique.

- Exactitude : mise à jour régulière des données d'apprentissage.

- Documentation : registre des traitements intégrant les traitements IA.

Sécuriser les données

- Accès restreint selon le rôle (principe du moindre privilège).

- Journalisation des accès.

- Chiffrement en transit et au repos.

- Cloisonnement des environnements (dev / test / prod).

- Interdiction par défaut d'injecter des données identifiantes dans des outils IA publics sans validation DPO.

AI Act 2026 : ce que les outils marketing doivent anticiper dès maintenant

L'AI Act classe les systèmes IA selon leur niveau de risque. Voici ce que cela signifie concrètement pour vos outils CRM :

Fonctionnalité | Niveau de risque | Sanctions possibles |

Chatbot support | Limité | 7 500 000 € ou 1,5 % CA |

Recommandations produits | Minimal / Limité | Transparence requise |

Scoring leads / churn | Haut risque | 15 000 000 € ou 3 % CA |

A partir d’août 2026, les systèmes à haut risque doivent disposer d'un marquage CE, d'une documentation technique complète, de logs détaillés, d'une supervision humaine et d'un monitoring post-lancement.

Et attention : même si vous utilisez un outil SaaS avec IA intégrée, la responsabilité reste partagée. En tant qu'utilisateur, vous restez responsable de la conformité.

Bonnes pratiques pour un data scientist marketing en PME

Un data scientist jongle chaque jour avec des données CRM, comportementales et relationnelles. Son cycle de travail typique passe par la préparation et l'anonymisation des données, la construction du modèle (régression, arbres de décision, scoring), le déploiement dans le CRM et la mesure du ROI (chiffre d'affaires incrémental, churn évité).

Quelques bonnes pratiques indispensables :

- Anonymisation ou pseudonymisation avant tout entraînement.

- Tests réguliers de biais algorithmiques.

- Documentation des versions de modèles.

- Supervision humaine pour les décisions à fort impact (tarification, refus d'offre).

Ce que toute TPE marketing peut faire dès cette semaine

Pas besoin d'un grand projet pour commencer. Voici une checklist rapide et actionnable :

- Aucune donnée sensible dans des IA publiques non validées.

- Accès aux outils IA via compte nominatif et authentification forte.

- Anonymisation systématique des jeux de test.

- Revue régulière des journaux d'accès.

- Formation annuelle des équipes marketing et communication.

FAQ IA marketing

- Une PME qui utilise un chatbot doit-elle informer ses clients ?

Oui, sans exception. L'AI Act impose une mention claire du type "Vous parlez à une IA" pour les systèmes à risque limité. L'absence de transparence peut entraîner une sanction jusqu'à 7 500 000 € ou 1,5 % du chiffre d'affaires. - Le scoring de leads est-il considéré comme à haut risque ?

S'il influence de manière significative l'accès à une offre, une tarification ou une décision commerciale importante, il peut être classé à haut risque depuis août 2026, avec des obligations de marquage CE et de documentation renforcée. - Une TPE doit-elle réaliser une AIPD ?

Oui, si le traitement présente un risque élevé pour les droits des personnes : profilage poussé, décisions automatisées significatives ou données sensibles. - Peut-on utiliser des données clients existantes pour entraîner un modèle IA ?

Seulement si la finalité est compatible avec celle d'origine ou après avoir réalisé un test de compatibilité documenté et vérifié la base légale. - Quelle est l'amende maximale en cas de non-conformité ?

- RGPD : jusqu'à 20 000 000 € ou 4 % du chiffre d'affaires mondial.

- AI Act : jusqu'à 35 000 000 € ou 7 % du chiffre d'affaires en cas de pratiques interdites.

Maîtrisez les risques liés à l'usage de l'IA avec Hiscox

Hiscox propose une assurance dédiée aux professionnels du marketing et de la communication